Tehnologiile AI au marcat cu siguranță anul 2023, iar această industrie se află încă la început de drum. Azi vin vești de la Aleph Alpha, un start-up german care lucrează pentru a face din Europa un jucător important în domeniul inteligenței artificiale. Aflăm că au fost implementate sistemele HPE Apollo 6500 Gen10 Plus și serverele DL385, alimentate de procesoare AMD EPYC, cu scopul de a crea modele de inteligență artificială (AI) care reflectă diversitatea lingvistică a Europei. Detalii avem mai jos.

Inteligența artificială vine în ajutorul oamenilor, iar Europa recunoaște că trebuie să creeze modele AI care să reflecte diversitatea lingvistică a continentului. Astfel, startup-ul german Aleph Alpha conduce răspunsul Europei prin dezvoltarea unor modele de procesare a limbajului natural în limbile engleză, franceză, germană, italiană și spaniolă.

Limbajul joacă un rol important când vorbim de AI, întrucât permite comunicarea și interacțiunea dintre oameni și mașini / roboți. Astfel e facilitată dezvoltarea modelelor de procesare a limbajului natural (numit NLP) care pot înțelege, interpreta și genera limbaj uman. Modelele multilingve de AI sunt esențiale pentru a aborda diversitatea lingvistică, pentru a promova incluziunea și pentru a permite accesibilitatea globală la tehnologie. În acest fel impactul inteligenței artificiale asupra umanității este extins.

Aleph Alpha are deja un model AI numit Luminous. El poate procesa, analiza și genera diverse texte fără o pregătire specifică a utilizatorului, folosind peste 200 de miliarde de parametri. Luminous este un serviciu accesibil mai multor utilizatori printr-o interfață interactivă.

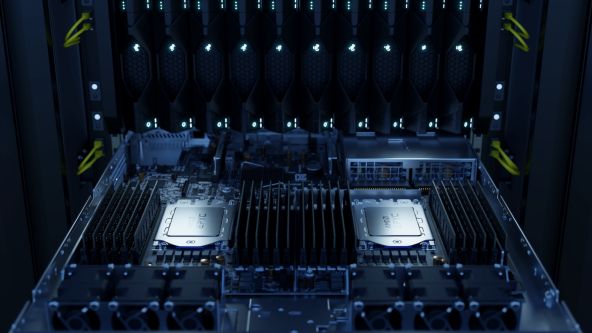

Utilizând tehnologia HPE pentru a sprijini dezvoltarea modelului NLP, Aleph Alpha a construit un centru de date puternic și inteligent, care dispune de servere HPE ProLiant DL385 cu procesoare AMD EPYC, cel mai performant CPU pentru servere x86 din lume. Centrul poate gestiona sarcini de lucru uriașe de calcul și oferă o izolare a sarcinilor de lucru pentru diferite proiecte și utilizatori.

Lutz Kirchner, CEO-ul Alpha Layer GTS GmbH, a declarat, subliniind modul în care AMD a sprijinit compania în dezvoltarea modelelor sale AI inovatoare:

„Avem un centru de date de 200 mp cu performanțele unui centru de 2.000 mp. HPE și AMD au adus performanțe remarcabile și ne-au făcut mult mai competitivi.”

Un studiu de caz care dezvoltă importanța dezvoltării modelelor AI care să reflecte diversitatea lingvistică din Europa aveți aici.